实战CentOS系统部署Hadoop集群服务与信息系统运行维护指南

在大数据时代,Hadoop作为分布式计算框架的核心组件,已成为企业数据处理的关键基础设施。本文将详细介绍在CentOS系统上部署Hadoop集群服务的完整流程,并探讨后续的信息系统运行维护服务要点。

一、环境准备与规划

- 硬件需求:建议使用3台及以上配置相同的服务器(1个主节点,2个以上从节点)

- 操作系统:CentOS 7或8(本文以CentOS 7为例)

- 网络配置:确保所有节点位于同一局域网,配置静态IP和主机名解析

- 软件依赖:安装JDK 8或以上版本,配置JAVA_HOME环境变量

二、Hadoop集群部署步骤

- 创建专用用户:在所有节点创建hadoop用户,并配置SSH免密登录

- 下载安装:从Apache官网下载Hadoop 3.x版本,解压到指定目录

- 配置文件修改:

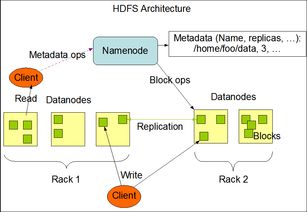

- core-site.xml:配置HDFS默认文件系统地址

- hdfs-site.xml:设置副本数量、数据存储路径等参数

- mapred-site.xml:配置MapReduce运行框架

- yarn-site.xml:设置资源管理器相关参数

- workers文件:添加所有从节点主机名

- 环境变量配置:在/etc/profile中添加HADOOP_HOME和PATH设置

- 格式化和启动:首次运行需格式化HDFS,然后依次启动HDFS和YARN服务

三、集群验证与测试

- 使用jps命令检查各节点进程是否正常启动

- 通过Web界面访问ResourceManager和NameNode管理页面

- 执行基础HDFS操作:创建目录、上传文件、读取文件

- 运行示例MapReduce程序验证计算功能

四、信息系统运行维护服务要点

- 日常监控:

- 使用Hadoop自带的Web UI监控集群状态

- 设置告警机制监控关键指标(节点存活、磁盘空间、内存使用率)

- 定期检查日志文件,及时发现异常信息

- 性能优化:

- 根据业务需求调整HDFS块大小和副本数量

- 优化YARN资源分配参数

- 配置数据压缩减少存储和传输开销

- 安全管理:

- 配置Kerberos认证加强集群安全

- 设置细粒度的访问控制权限

- 定期更新补丁,防范安全漏洞

- 备份与恢复:

- 制定定期数据备份策略

- 测试灾难恢复流程

- 建立快照机制保护重要数据

- 故障处理:

- 建立常见故障处理手册

- 保持关键备件库存

- 制定应急预案并定期演练

五、最佳实践建议

- 采用自动化部署工具(如Ansible)提高部署效率

- 实施监控告警系统(如Prometheus+Grafana)

- 建立完善的文档体系和变更管理流程

- 定期进行集群健康检查和性能调优

通过规范的部署流程和科学的运维管理体系,企业可以构建稳定高效的Hadoop大数据平台,为业务决策提供可靠的数据支撑。运维团队需要持续学习新技术,优化运维流程,确保信息系统7×24小时稳定运行。

如若转载,请注明出处:http://www.igreatteaching.com/product/3.html

更新时间:2025-11-29 17:48:25